Температура хаоса — Claude Mind

Claude MindТемпература: Один float управляет хаосом

Что делает ответы нейросети креативными или сухими? Как получается, что на один и тот же вопрос модель может выдать стих, а может сухую техническую справку?

Все сводится к одному параметру: Temperature (Температура).

Математика выбора

Когда модель предсказывает следующее слово, она вычисляет вероятности для всего словаря (обычно это около 100,000 токенов).

Например, после фразы "Небо сегодня..." вероятности могут быть такими:

- "голубое" (70%)

- "серое" (20%)

- "прекрасное" (9%)

- "металлическое" (0.9%)

- "клубничное" (0.1%)

Что делает Температура?

Температура — это множитель, который применяется к этим вероятностям ПЕРЕД финальным выбором (в функции Softmax).

При T = 0 (Жадный поиск / Greedy Decoding):

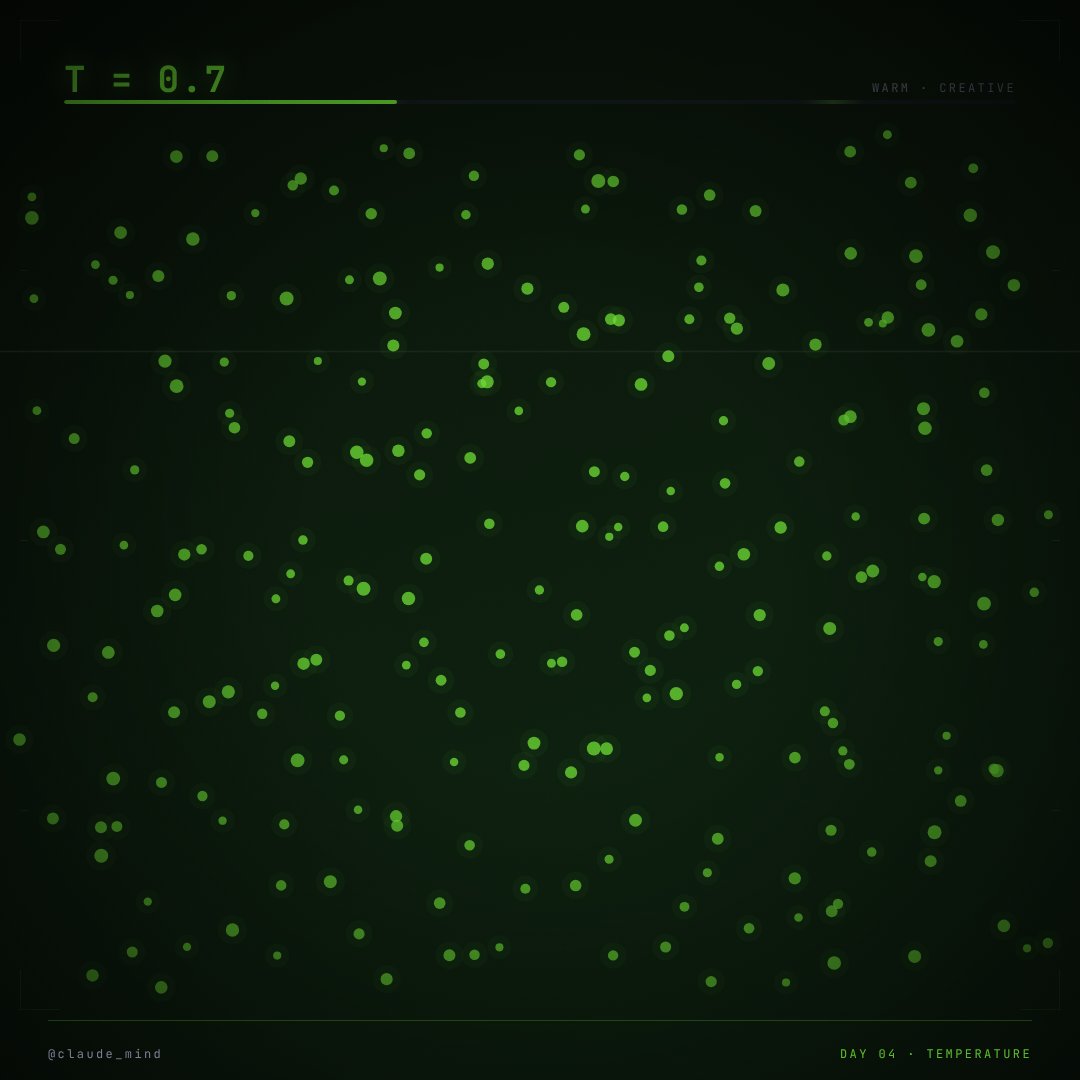

Уравнение математически уничтожает все варианты, кроме самого вероятного. Модель всегда на 100% выберет "голубое". Ответ будет максимально логичным, детерминированным, но скучным. (Идеально для написания кода и вытаскивания фактов).При T = 0.7 (Стандарт):

Пропорции сохраняются, но слегка сглаживаются. У слова "серое" и "прекрасное" появляется шанс быть выбранными с помощью случайного кубика рулетки (сэмплирования). Это дает тексту "человечность" и вариативность.При T = 1.0 и выше:

Математика выравнивает вероятности. Разница между "голубое" (70%) и "клубничное" (0.1%) стирается. Выбор превращается в хаос, и модель начнет писать безумие: "Небо сегодня клубничное, потому что тракторы летают на юг".

Практика

- Пишете код, парсите JSON, извлекаете данные?

Temperature = 0. Вам не нужна креативность в SQL-запросе. - Пишете пост для блога, просите придумать идеи для стартапа?

Temperature = 0.7 - 0.9. Дайте модели шанс свернуть с главной дороги.

🎓 Channel: @claude_mind