Нейронные сети в СССР: создатели и развитие

Цифровой профсоюз!История нейронных сетей в СССР

Над нейронными сетями, начиная с конца 50-х годов 20-го века, активно работали в Советском союзе.

1960-е по праву можно назвать золотым веком советской науки.

К 1975 году 25% от всего количества учёных в мире работала в СССР, при этом большое внимание уделялось точным наукам, результаты которых часто имели прикладное значение.

Не обходили стороной и кибернетику, в которой видели огромный потенциал. Ученые работали в области автоматического управления, машинного перевода и сетевых технологий.

В СССР существовала целая школа искусственного интеллекта!

Также в рамках кибернетики развивалось и направление, которое мы привыкли называть нейросетевым.

В 60-ые годы в СССР большими тиражами выходило несколько серьёзных тематических изданий, и, судя по наукометрической статистике, изрядная доля мировых коннекционистских исследований издавалась именно на русском языке.

Алексей Ивахненко и «Метод группового учёта аргументов»

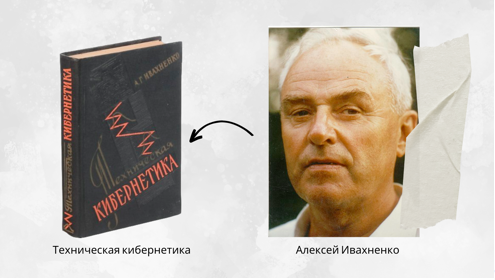

В 1965-м году в издательстве «Мир» впервые был осуществлен перевод на русский язык книги Фрэнка Розенблатта «Принципы нейродинамики». Одним из самых горячих поклонников подхода, использованного Розенблаттом, в СССР стал Алексей Григорьевич Ивахненко. Он начал заниматься перцептронами ещё до выхода этой книги и был знаком с ранними публикациями Розенблатта. В момент выхода перевода «Принципов нейродинамики» Ивахненко уже был признанным учёным, его книга «Техническая кибернетика», вышедшая до перевода принципов нейродинамики, не только выдержала два издания на русском языке, но также была опубликована на английском, немецком, болгарском, польском и румынском.

▪️ Перцептрон (англ. Perceptron) — простейший вид нейронных сетей. В основе лежит математическая модель восприятия информации мозгом, состоящая из сенсоров, ассоциативных и реагирующих элементов.

Научный интерес Ивахненко к самоорганизующимся системам проявился ещё в 1950-е годы: в 1959 году он успешно собрал и испытал собственную версию перцептрона — машину «Альфа».

Важным результатом, полученным Ивахненко, стало создание и развитие «Метода группового учёта аргументов» (МГУА), одного из первых в истории алгоритмов глубокого обучения. Для Ивахненко самообучение распознающей системы обозначало «процесс автоматического, то есть проходящего без вмешательства человека, установления границы, разделяющей пространство входных сигналов и признаков на области, отвечающие отдельным образам». Уже в начале 1970-х годов Ивахненко и его коллегам удавалось обучать восьмислойные нейронные сети, в основе которых лежал искусственный нейрон, основанный на интерполяционном полиноме Колмогорова — Габора.

Сети Ивахненко, содержащие восемь слоёв, явно опережали своё время.

В МГУА в нейронную сеть на каждом шаге добавляются дополнительные слои, обучаемые с использованием регрессионного анализа. Затем применяется процедура сокращения слоя. Для этого точность предсказаний каждого из нейронов оценивается при помощи валидационной выборки, а затем наименее точные нейроны удаляются.

Книга «Предсказание случайных процессов», написанная Ивахненко в соавторстве с Валентином Лапой и вышедшая в 1969 году, стала своеобразным сокращенным изложением основных положений техник, которые изучались советскими коннекционистами, а книга 1971-го года «Системы эвристической самоорганизации в технической кибернетике» содержит не только подробное описание МГУА, но и множество примеров его применения для решения прикладных задач.

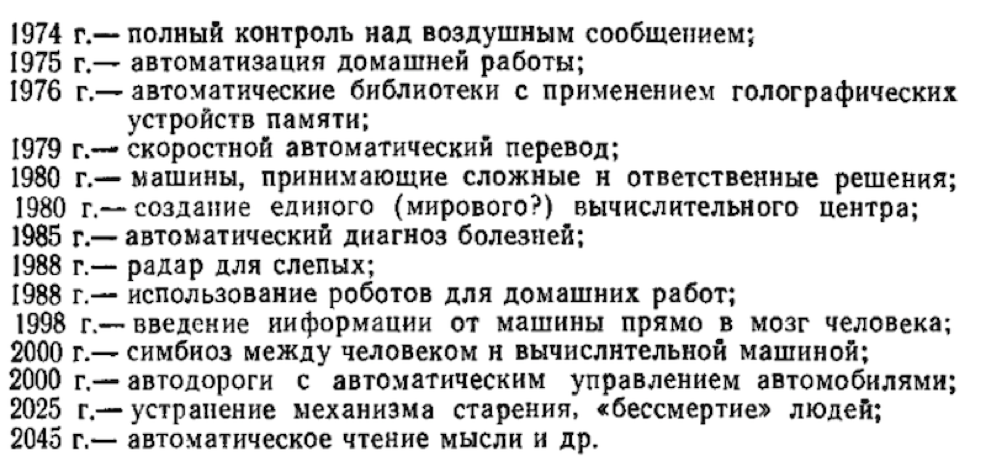

В своей книге Ивахненко писал:

«Уже в 1990-м году кибернетические системы автоматизированного управления производством (в масштабе завода, отрасли и всей страны) сократят потребность в рабочей силе на 50%, то есть, рабочая неделя может быть снижена до трёх рабочих дней».

Ивахненко удалось угадать важнейшие тренды в развитии вычислительной техники!

Ивахненко А.Г., Лапа В.Г. «Предсказание случайных процессов», издательство «Наукова думка», 1971 г.

В его книге можно увидеть и грядущее торжество персональных компьютеров, и триумфальное шествие интернета, и даже тенденцию на всё более тесное взаимодействие человека с машиной.

Хотя нейросетевые модели наших дней лишь отдалённо похожи на сети, построенные при помощи МГУА, именно данный метод в некоторой степени стал поворотным пунктом в коннекционистских исследованиях. Исследователями в полной мере был осознан тот факт, что обучение глубоких нейронных сетей в принципе возможно, и что именно их использование может обеспечить прорывные результаты в решении тех или иных задач машинного обучения. Многие работы Ивахненко и его коллег были переведены на английский язык, и отсылки к ним мы можем увидеть в современных работах по глубокому обучению. Метод группового учёта аргументов используется исследователями и в наши дни, хотя занимается им лишь небольшое количество специалистов.

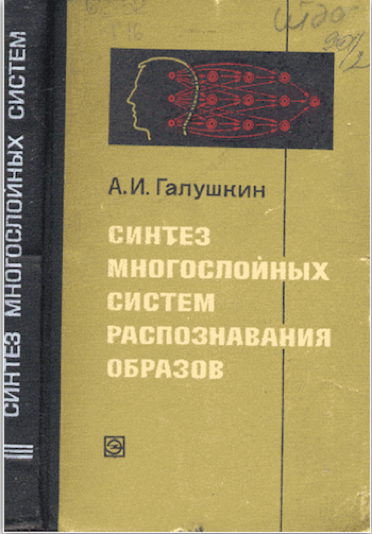

«Метод без названия» от Александра Галушкина

В августе 1974-го года тиражом 8 000 экземпляров вышла книга Александра Ивановича Галушкина, тогда — сотрудника МФТИ, под названием «Синтез многослойных систем распознавания образов». С точки зрения современной терминологии название книги можно понимать, как «Обучение многослойных нейронных сетей». Книга Галушкина стала первым систематическим изложением идей учёного, развитых им и его коллегами в предшествующие годы.

Первые публикации Галушкина на тему создания и обучения многослойных нейронных сетей относятся к 1971—1973 годам.

Галушкин рассматривает использование в нейронных сетях функций активации, отличных от функции Хевисайда и сигнума (обозначается «sgn», функция знака, имеющая три возможных значения: 0, 1 и −1). Необходимость применения функций с континуумом решений у Галушкина обосновывается следующим образом:

«Экспериментальное исследование данного алгоритма показало, что скорость сходимости при нахождении некоторой локальной моды мала, и причиной этого является применение в многослойной системе распознавания с двумя решениями, которые в значительной степени «загрубляют» информацию о градиенте функционала вторичной оптимизации при квантовании входного сигнала. В связи с этим основным предметом исследования являлась двухслойная система распознавания, по структуре подобная описанной выше, но состоящая из линейно-пороговых элементов с континуумом решений».

Галушкин рассматривает задачу обучения нейронной сети в качестве задачи градиентного спуска. Он применяет цепное правило для вычисления градиента, подробно рассматривает случай обучения сетей с двумя обучаемыми слоями, а также коротко показывает, как следует решать задачу в случае многослойных сетей и сетей с рекуррентными связями, но не даёт используемому им методу какого-либо собственного названия. При этом вопрос конкретной топологии сетей в книге практически не затрагивается, зато уделено внимание сетям с переменным числом слоёв: Галушкин описывает подход, напоминающий МГУА с послойным обучением и постепенно наращиваемыми слоями. Автор также приводит результаты множества экспериментов по обучению сетей с различными параметрами процесса обучения, стремясь оценить их влияние на сходимость модели. Кроме математических моделей, Галушкин совместно с В. Х. Наримановым ещё в начале 1970-х годов сконструировал собственную версию аппаратного перцептрона.

Александр Иванович Галушкин продолжал работу над нейросетевыми технологиями до самого конца своей жизни и был одним из наиболее ярких лидеров этого направления в Советском союзе, а затем и в России, на протяжении более чем сорока лет.

В новом тысячелетии работы Галушкина неоднократно выходили в международных научных изданиях и оказали влияние на состояние современной нейросетевой науки.

Терминология имеет значение

В те годы в советском мире нейроны не называли нейронами: то, что мы сейчас знаем как «нейросети», в советской традиции имело несколько других названий. Многослойный перцептрон (multilayer perceptron) у Ивахненко назывался многорядным, вместо нейронов учёный использовал термин «переменные», вместо сети — «фильтр». У Галушкина сеть называлась «системой распознавания», нейрон — «линейно-пороговым элементом», а обученная сеть (то есть сеть, предназначенная только для выполнения [inference]) — «сетью с разомкнутым контуром».

Почему учёные старались не использовать слово «нейрон»?

А потому, что это отсылка к биологическому прототипу — нейрону в коре головного мозга. Слои — это тоже вполне нейробиологический термин, унаследованный от слоёв клеток коры головного мозга, поэтому у Ивахненко перцептрон — многорядный.